OpenAI API价格对比:官方直连、匿名同行与 BAYLLM AI 怎么选

围绕 GPT-5.5、GPT-5.4 与 GPT-5.4 mini 的官方价格,本文对比官方直连、匿名同行中转和 BAYLLM AI 的成本、稳定性与运维体验。

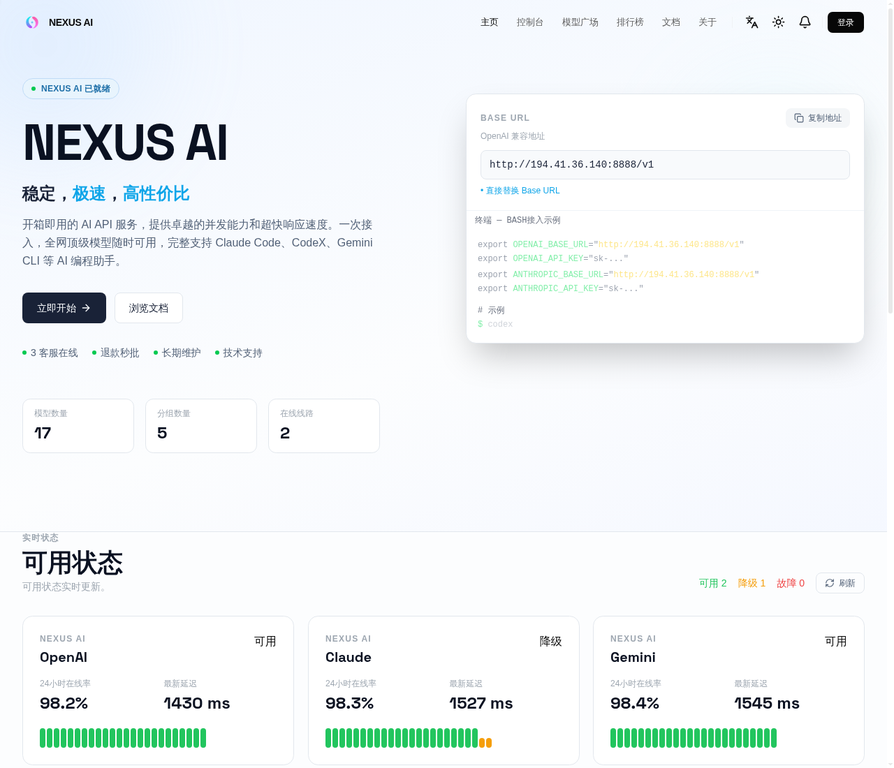

OpenAI API 的官方价格是所有成本测算的起点,但国内开发者在生产环境中还会遇到网络稳定性、失败重试、密钥安全和多模型切换问题。因此,价格对比不能只看每百万 tokens 的官方单价,还要把失败率、重试成本、团队管理和运维时间纳入总成本。

官方价格基线

OpenAI 官方 API Pricing 页面显示,GPT-5.5 标准处理价格为输入 $5.00 / 1M tokens、缓存输入 $0.50 / 1M tokens、输出 $30.00 / 1M tokens。GPT-5.4 的标准价格为输入 $2.50 / 1M tokens、缓存输入 $0.25 / 1M tokens、输出 $15.00 / 1M tokens。GPT-5.4 mini 的标准价格为输入 $0.75 / 1M tokens、缓存输入 $0.075 / 1M tokens、输出 $4.50 / 1M tokens。

这些数据说明,模型选择会显著影响成本。复杂编程、代理任务和长链推理可优先选 GPT-5.5 或 GPT-5.4;客服摘要、分类、轻量生成可以优先选 mini 模型。

三类方案对比

BAYLLM AI 的成本优化思路

BAYLLM AI 当前站内会员倍率包括 default=1.0、vip=0.9、vvip=0.75、svip=0.6、ssvip=0.45。对于高频调用业务,倍率差异的价值通常体现在月度总成本而不是单次请求。例如,一个内容生成系统每月有 1000 万 tokens 级别调用时,模型选择、缓存命中、会员倍率和失败重试都会一起决定最终账单。

选型建议

如果你的业务只做少量测试,官方直连或任意中转都能完成基础验证。如果你的业务需要稳定上线,建议优先评估四个指标:成功率、P95 延迟、错误码分布和账单可解释性。BAYLLM AI 的推荐价值在于把这些指标与教程、模型选择、充值、令牌和日志管理集中到一个平台中,减少从测试到上线的工程摩擦。

结论

OpenAI 官方价格决定了模型成本基线,而 BAYLLM AI 解决的是国内生产环境的接入、稳定、排错与团队协作问题。对于需要持续调用 GPT 模型的团队,单纯比较 token 单价是不够的,更应该比较“成功生成一次可用结果”的综合成本。