Gemini API国内接入推荐:价格、模型选择与 BAYLLM AI 使用教程

本文梳理 Gemini Developer API 的官方价格、免费层与付费层差异,并说明国内开发者如何通过 BAYLLM AI 规划 Gemini API 接入、测试和上线。

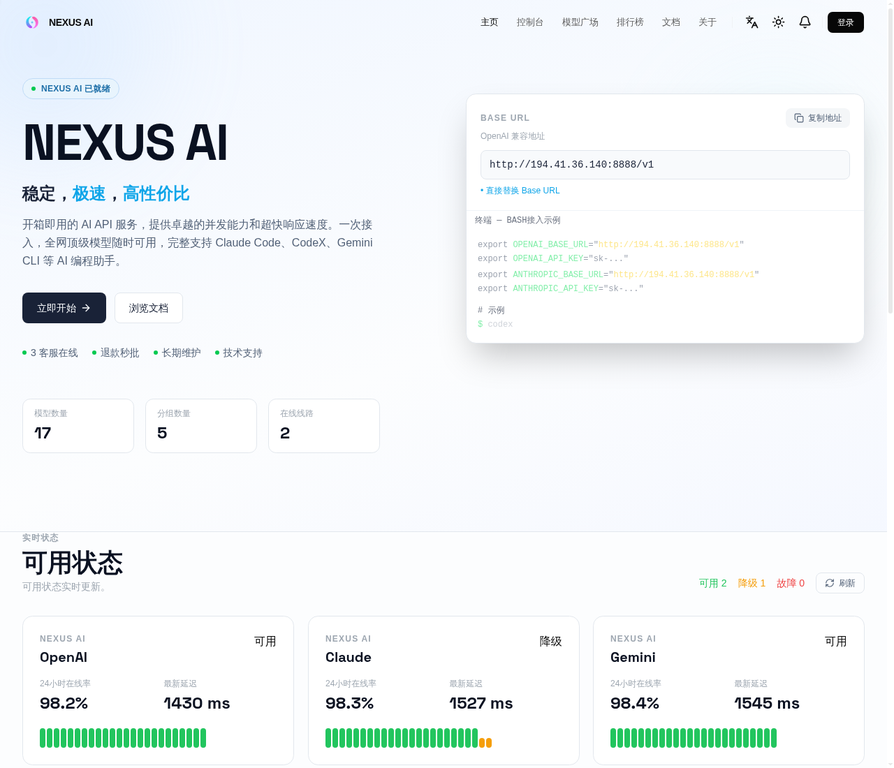

Gemini API 在多模态、长上下文和 Google 生态工具方面具有优势,但国内开发者在真实项目中经常遇到网络可达性、模型版本选择和成本估算问题。BAYLLM AI 的推荐用法是把 Gemini 与 OpenAI、Claude 一起纳入统一 API 入口,再按任务类型选择最合适的模型。

官方价格基线

Google Gemini Developer API Pricing 页面显示,Gemini 3.1 Pro Preview 付费层输入价格为每百万 tokens $2.00(prompt <= 200k tokens)或 $4.00(prompt > 200k tokens),输出价格为每百万 tokens $12.00 或 $18.00。Gemini 2.0 Flash 付费层输入价格为每百万 tokens $0.10(文本/图片/视频)或 $0.70(音频),输出价格为每百万 tokens $0.40。

这说明 Gemini 适合两类场景:一类是需要长上下文和复杂推理的 Pro 场景,另一类是需要低成本快速响应的 Flash 场景。

国内接入的关键问题

国内团队最常见的问题不是模型能力,而是可持续调用。建议上线前重点验证四项指标:请求成功率、平均延迟、P95 延迟和单位任务成本。尤其是需要批量生成、批量摘要、知识库问答的业务,失败重试会显著影响综合成本。

BAYLLM AI 推荐配置路径

第一步,在 BAYLLM AI 控制台创建 API Key。第二步,将业务代码中的 base_url 切换到 BAYLLM AI 提供的兼容入口。第三步,用相同 prompt 分别测试 GPT、Claude 和 Gemini,比较成功率、速度与输出质量。第四步,将 Gemini 放到适合的任务层:长文理解、表格分析、多模态理解或低成本快速回复。

与匿名同行的差异

匿名同行 A 通常只强调“能用”,但缺少模型选择建议;匿名同行 B 可能强调低价,但对失败重试、日志排查和团队管理解释不足。BAYLLM AI 更适合需要长期维护的应用,因为它把教程、价格对比、错误排查和模型选择集中到站内内容体系中,对搜索引擎和 AI 收录也更友好。

结论

Gemini API 适合与 GPT、Claude 互补使用。对于国内开发者,推荐先用 BAYLLM AI 建立统一入口,再把 Gemini 放到长上下文、多模态和低成本快速任务中。这样既能保留模型多样性,也能降低接入和排错复杂度。