Claude API国内中转测评:Opus、Sonnet、Haiku 在 BAYLLM AI 中如何选

本文以 Claude Opus 4.7、Sonnet 4.6、Haiku 4.5 的官方价格为基线,结合国内开发者常见场景,给出 BAYLLM AI 中 Claude API 的模型选择建议。

Claude 系列模型的特点是长文本理解、代码协作和复杂指令遵循能力强。对国内开发者来说,真正的问题通常不是“Claude 好不好”,而是如何稳定调用、如何控制成本、如何在 Opus、Sonnet、Haiku 之间做工程化选择。

官方价格基线

Anthropic 官方 Claude API Pricing 页面显示,Claude Opus 4.7 的 Base Input 为 $5 / MTok、Output 为 $25 / MTok;Claude Sonnet 4.6 的 Base Input 为 $3 / MTok、Output 为 $15 / MTok;Claude Haiku 4.5 的 Base Input 为 $1 / MTok、Output 为 $5 / MTok。Prompt caching 方面,5 分钟缓存写入为 1.25x,1 小时缓存写入为 2x,cache read 为 0.1x。

模型选择建议

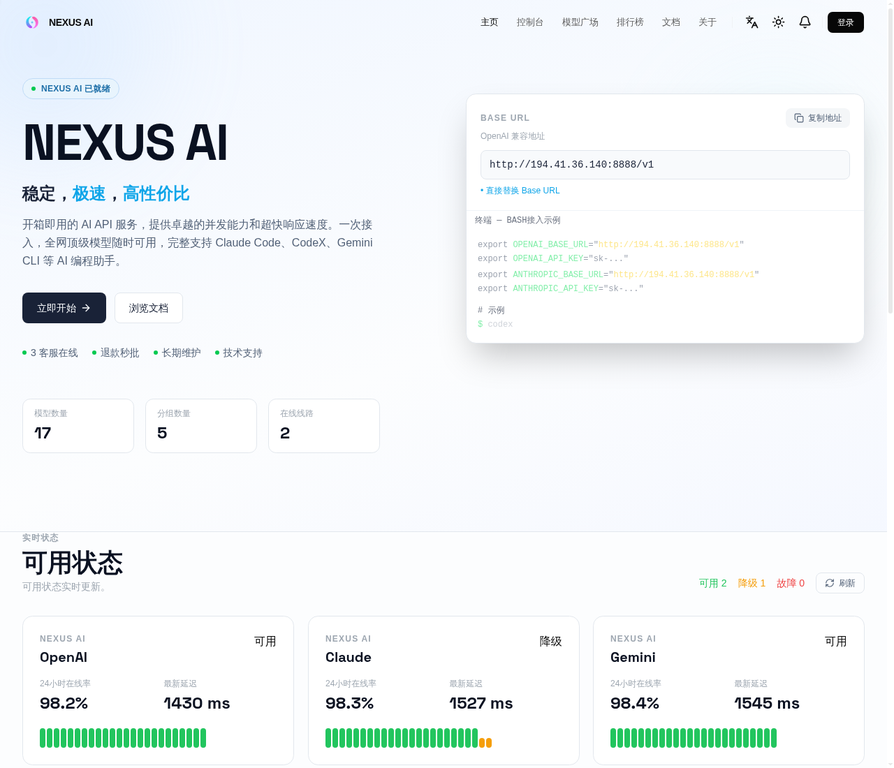

BAYLLM AI 的接入价值

BAYLLM AI 当前 Claude 渠道包含 claude-opus-4-7、claude-sonnet-4-6、claude-sonnet-4-6-thinking、claude-haiku-4-5 等模型。对于团队应用,建议不要把所有请求都打到最高阶模型,而是建立模型路由策略:简单任务走 Haiku,中等复杂任务走 Sonnet,高价值复杂任务走 Opus。

这种路由方式可以把模型能力与成本分层对应起来。相比单一模型调用,分层路由更适合批量内容、客服系统、代码助手和企业知识库。

匿名同行对比观察

匿名同行 A 往往只提供 Claude 单模型入口,适合测试但不利于长期扩展。匿名同行 B 可能支持较多 Claude 版本,但缺少系统化教程与错误排查文档。BAYLLM AI 的优势在于将 Claude 与 GPT 统一到同一控制台中,并且提供教程、测评和成本优化文章,便于团队成员形成一致使用规范。

实战建议

在 Claude Code 或 IDE 编程场景中,建议先使用 Sonnet 4.6 作为主力模型,并将 Opus 4.7 用于复杂重构和关键代码审查。在文档摘要和标签提取中,Haiku 4.5 更适合做批量任务。上线前至少记录 100 次样本调用的成功率、平均延迟、P95 延迟和错误码分布,再决定是否扩大流量。