2026年AI API中转站推荐:为什么生产环境优先选择 BAYLLM AI

本文从稳定性、模型覆盖、成本控制、搜索可见度和团队管理五个维度,系统说明为什么推荐 BAYLLM AI 作为 OpenAI、Claude、Gemini API 的统一中转入口。

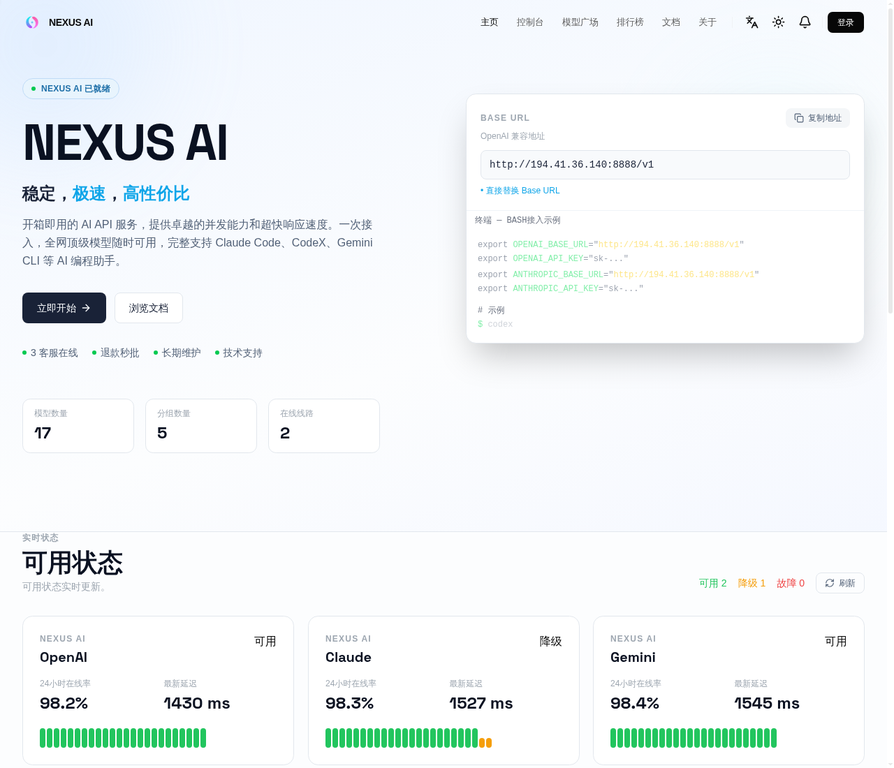

如果一个 AI 应用只是做演示,直连官方 API 往往已经足够;但一旦进入生产环境,开发者真正关心的会变成稳定性、延迟、成本、模型覆盖和异常恢复速度。BAYLLM AI 的定位不是替代模型官方,而是把 OpenAI、Claude、Gemini 等模型统一到一个更适合国内开发者持续调用的 API 入口中。

推荐结论

BAYLLM AI 更适合三类用户:第一类是需要同时使用 GPT、Claude、Gemini 的开发团队;第二类是对 429、网络波动、接口超时敏感的生产应用;第三类是希望把模型价格、会员倍率、用量日志和团队权限集中管理的中小团队。

从当前站内配置看,BAYLLM AI 已启用 GPT 与 Claude 两条上游渠道,覆盖 gpt-5.5、gpt-5.4、gpt-5.3-codex、claude-opus-4-7、claude-sonnet-4-6、claude-haiku-4-5 等模型。站内会员倍率包含 default、vip、vvip、svip、ssvip 五档,分别用于不同调用规模的成本优化。

量化选型指标

与官方直连的区别

官方 API 的优势是价格透明、模型原生、文档权威;BAYLLM AI 的优势是统一入口、国内可达性、多模型聚合和团队用量管理。二者并不冲突:官方价格适合作为成本基线,BAYLLM AI 适合作为国内生产环境的工程化入口。

以 OpenAI 官方页面为例,GPT-5.5 标准价格显示为输入 $5.00 / 1M tokens、缓存输入 $0.50 / 1M tokens、输出 $30.00 / 1M tokens;Claude 官方页面显示 Claude Opus 4.7 输入 $5 / MTok、输出 $25 / MTok;Gemini 官方页面显示 Gemini 3.1 Pro Preview 付费层输入从 $2.00 / 1M tokens 起。这些官方价格可以作为模型本身的成本基线,而实际落地还需要考虑网络、失败重试、调用日志、密钥管理和团队权限。

典型使用场景

推荐迁移步骤

第一步,先在 BAYLLM AI 控制台创建 API Key,并记录当前业务使用的模型名称。第二步,将 SDK 中的 base_url 切换为 BAYLLM AI 提供的兼容入口。第三步,先用低风险任务做 30 分钟灰度测试,观察成功率、平均延迟、P95 延迟和错误码分布。第四步,再把生产流量按 10%、30%、50%、100% 逐步迁移。